2025-11-03

Innovation Highlights

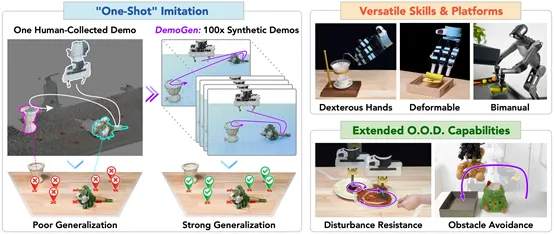

许华哲团队提出了DemoGen,一种用于机器人操作的合成数据方法。该方法可以用极低的计算和时间成本,生成视觉逼真的、针对待操作物体实现空间增强的、且具有对抗外界干扰与避障行为的合成数据,旨在改善机器人操作策略的泛化性。实验表明,仅需要一条由人类采集的原始数据,DemoGen即可生成大量的高质量合成操作数据,从而可以训练出具有良好泛化行的机器人操作策略。

Achievements Summary

DemoGen:用于机器人操作的合成数据生成

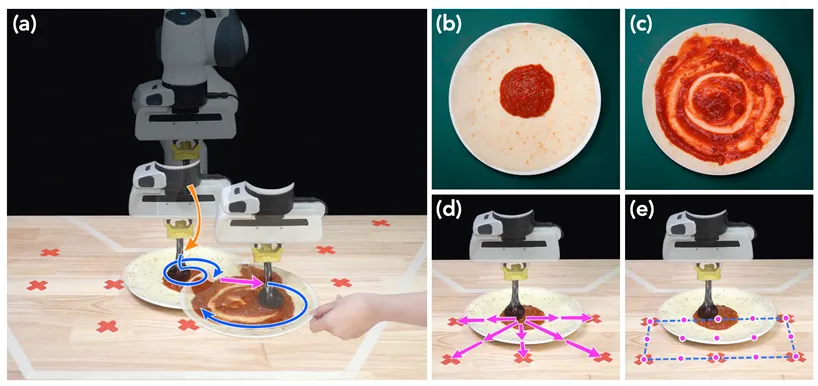

图.全自动合成的示范生成方法DemoGen

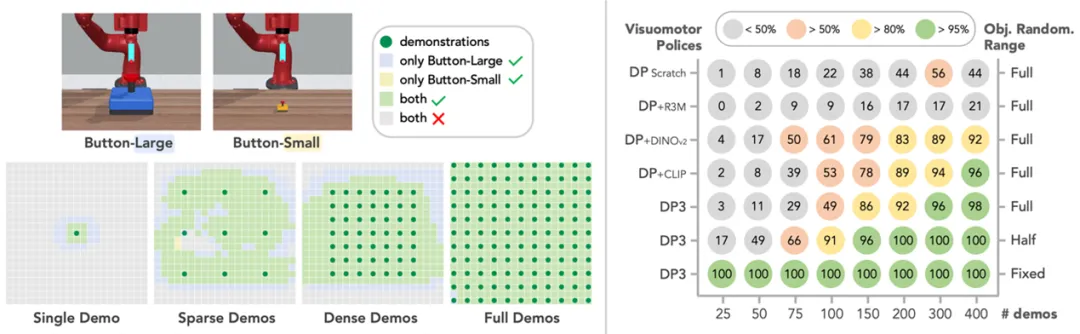

通过定性和定量的实证研究,团队发现:缺乏空间泛化能力是机器人操作策略需要大量数据的一个关键诱因。这一发现揭示了在数据驱动的机器人策略训练过程中普遍存在的、数据采集资源的不合理分配:真正赋予灵巧操作能力的、与物体发生密切接触的技能片段是高度重复的;但是大量的资源被用于实现空间泛化能力,而这通过简单的运动规划即可完成。

图. 空间有效范围的定性可视化与空间泛化能力的定量基准测试

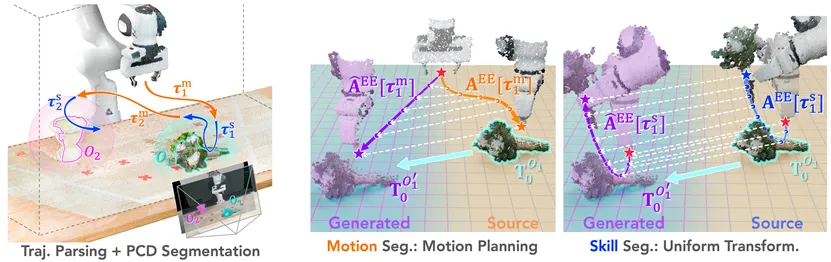

针对上述的空间泛化问题,团队提出的DemoGen方法利用动作规划生成合成动作,利用点云编辑生成合成视觉观测,可以生成出视觉逼真的、针对待操作物体实现空间增强的合成操作数据。同时,作为一种全合成的数据生成方法,DemoGen取得了极高的生成效率,相较于之前的方法提升了四个数量级,从而可以方便地在真实世界中部署。

图. 源示范数据的预处理流程,及动作生成的可视化说明

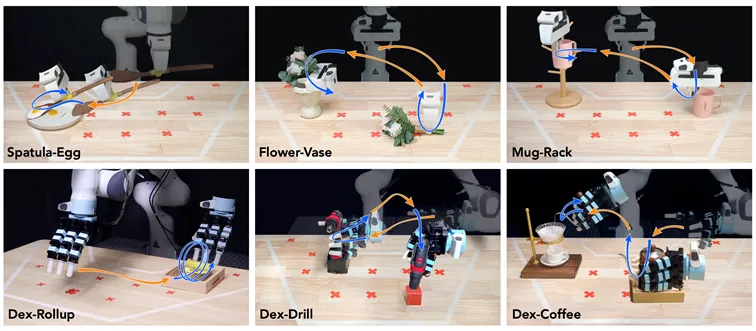

在仅使用一条人类演示作为原始数据的限制下,团队成功将DemoGen部署到多样化的机器人平台,包含单臂夹爪、单臂灵巧手、双臂人形,进行了大量严格的真机实验,验证了DemoGen方法的有效性。

图. 真实场景下的空间泛化能力评测任务集

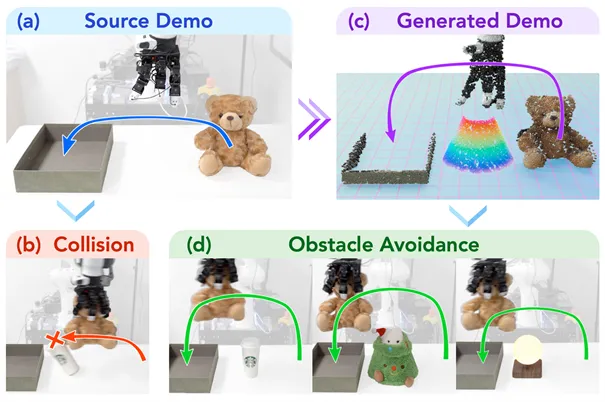

此外,团队还演示了通过功能拓展,DemoGen框架可以进一步支持得到对抗外界干扰与避障的分布外泛化能力。

图8. DemoGen在抗干扰任务中的应用

图 DemoGen在避障任务中的应用

DemoGen可改善机器人操作策略的泛化性。本论文共同一作为研究院实习生、清华大学博士生薛峥嵘,清华大学本科生邓舒颖,通讯作者为研究院PI、清华大学助理教授许华哲。其他作者为研究院实习生陈臻洋,研究院实习生、清华大学本科生王怿轩,研究院实习生、清华大学博士生袁哲诚。

论文信息:

DemoGen: Synthetic Demonstration Generation for Data-Efficient Visuomotor Policy Learning, Zhengrong Xue*, Shuying Deng*, Zhenyang Chen, Yixuan Wang, Zhecheng Yuan, Huazhe Xu†, https://demo-generation.github.io/,RSS 2025