2025-07-08

Innovation Highlights

许华哲—提出了逆扩散模型元观测框架。当前视觉模仿学习方法表现出强大的性能,然而,当面临视觉输入扰动(包括光照和纹理的变化)时,它们缺乏泛化能力,这阻碍了它们在现实世界中的应用。该文章提出了 Stem-OB 方法,该方法利用预训练的图像扩散模型来抑制低级视觉差异,同时保持高级场景结构。这种图像反演过程类似于将观察结果转换为通用的元表示,其他观察结果由此衍生而来,并移除了无关的细节。

Achievements Summary

借助逆扩散过程生成类干细胞观测助力可泛化的视觉模仿学习

模仿学习是机器人通过观察专家的示范行为学习执行任务的方法。其中,视觉模仿学习是一种利用高维视觉观察的方法,用于特定任务的状态估计。然而在面对视觉输入扰动时,如照明和纹理变化,视觉模仿学习仍存在泛化性不足的问题。

Stem-OB 通过使用预训练的图像扩散模型创建一种“干细胞状”的收敛观察,为视觉模仿学习引入了一种创新方法。该方法解决了视觉模仿学习在面对如光照和纹理变化的非特定视觉输入扰动时泛化能力差的关键问题。

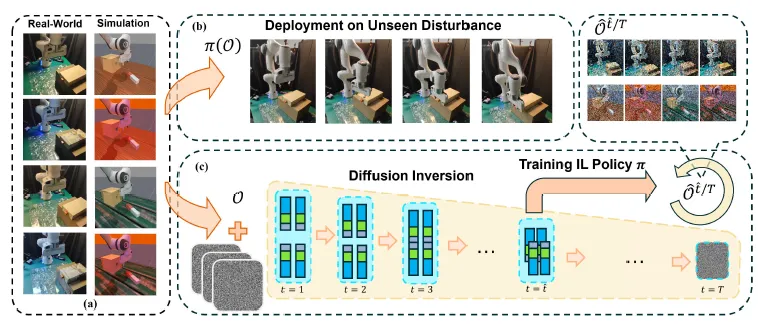

图. Stem-OB概览

其核心创新在于通过图像反演过程,在抑制低级视觉差异的同时保留高级场景结构的能力。这有效地将多样化的视觉输入转换为共享的、规范的表示,并剥离了无关的细节。与传统的数据增强技术不同,Stem-OB 无需额外训练即可对各种视觉变化保持鲁棒性,使其成为一种简单而高效的即插即用解决方案。

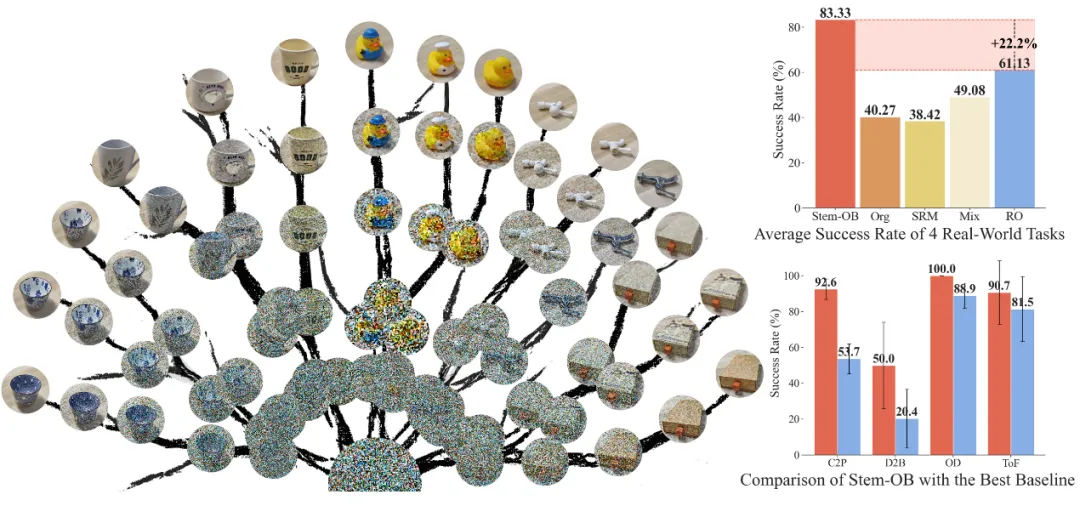

Stem-OB 的重要价值通过其经验结果得到了证明。它在模拟任务中显示出显著的有效性,并在实际应用中取得了非常显著的改进。具体而言,在真实世界场景中,与最佳基线方法相比,其成功率平均提高了22.2%。这突显了其在使视觉模仿学习在动态、真实的现实环境中更加可靠和适用方面的潜力。

图. Stem-OB反演树由通过扩散反演过程逐步倒置的不同物体构成。

Stem-OB 提供了一种简单却高效的即插即用解决方案,与数据增强方法形成鲜明对比,展现出强大鲁棒性。相关成果被ICLR接收为spotlight(占全部文章的5.1%)。本论文共同第一作者为上海期智研究院实习生、清华大学博士生胡开哲,清华大学芮子航,通讯作者为上海期智研究院PI、清华大学助理教授许华哲。共同作者为斯坦福大学贺遥,清华大学本科生刘域尧,上海期智研究院实习生、清华大学博士生华朴。

论文信息:

Stem-Ob: Generalizable Visual Imitation Learning with Stem-Like Convergent Observation through Diffusion Inversion, Kaizhe Hu*, Zihang Rui*, Yao He, Yuyao Liu, Pu Hua, Huazhe Xu†, https://hukz18.github.io/Stem-Ob/,ICLR 2025.