2025-11-03

Innovation Highlights

高阳团队提出了SKIL框架,通过结合视觉基础模型自动获取语义关键点,并基于关键点构建紧凑且具备语义对齐能力的表示,有效提升机器人复杂操作任务中的模仿学习效率。该方法在不增加训练数据的前提下,将抓取杯子、鼠标等日常物品的成功率提升至现有基线方法的2倍,同时展现出对物体变化、环境扰动和干扰物的强鲁棒性。

Achievements Summary

DOGlove:开源友好的低成本力触觉反馈动作捕捉手套

端到端策略学习在机器人系统训练中受到广泛关注。模仿学习通过从专家示范中进行监督学习,有效提升了端到端训练的效率。尽管现有方法在多种机器人操作任务中取得了进展,但现实任务如衣物操作与桌面整理,仍对策略的泛化能力、精度及长时序规划提出更高要求。然而复杂任务的数据采集过程既耗时又昂贵。近期一项研究展示了类似技能的实现,依赖近一万次机器人示范。

为应对高样本复杂度挑战,高阳团队主要从两方面入手:一是改进数据采集方式,二是发展更强的表示学习方法。前者通过构建多样化的数据集,或在多环境中采集带有不同操作对象的示范,以提升泛化能力。后者则探索如预训练视觉模型、3D视觉表示及语义-几何特征等新型表示,旨在提升空间泛化能力和样本效率。尽管已有进展,这些方法在面对未见对象和场景时仍存在过拟合问题。因此,关键问题在于:如何降低样本复杂度,使机器人高效学习具备泛化能力的操作策略。

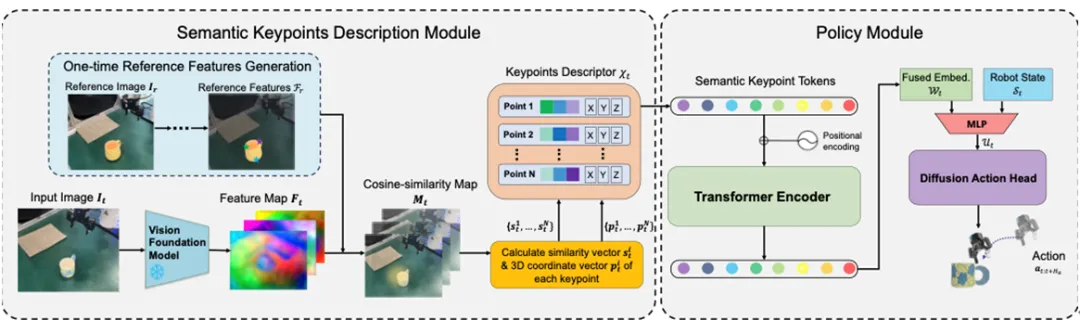

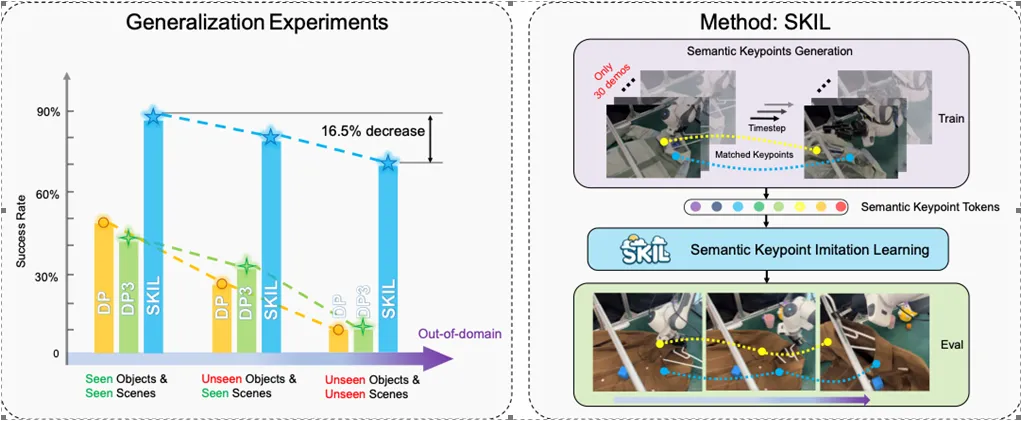

图. SKIL算法图

因此高阳团队提出了一种基于语义关键点的模仿学习框架—SKIL(Semantic Keypoints Imitation Learning)。该方法利用视觉基础模型自动提取稀疏的语义关键点作为观察输入,从而降低问题维度,显著减少样本需求。通过在训练与测试对象间匹配一致的关键点,SKIL将其特征与空间信息作为条件输入,结合扩散模型生成动作。SKIL具备三大优势:稀疏表示带来高效学习、关键点描述增强策略鲁棒性、可支持跨载体模仿学习。此外,语义关键点的抽象表示也天然支持跨载体(如人-机器人)学习。在6项现实任务中,SKIL平均成功率达72.8%,相较现有方法提升146%,且仅需30次示范即可完成如“挂毛巾”这类长时序任务,基线方法在此类任务中表现不佳。

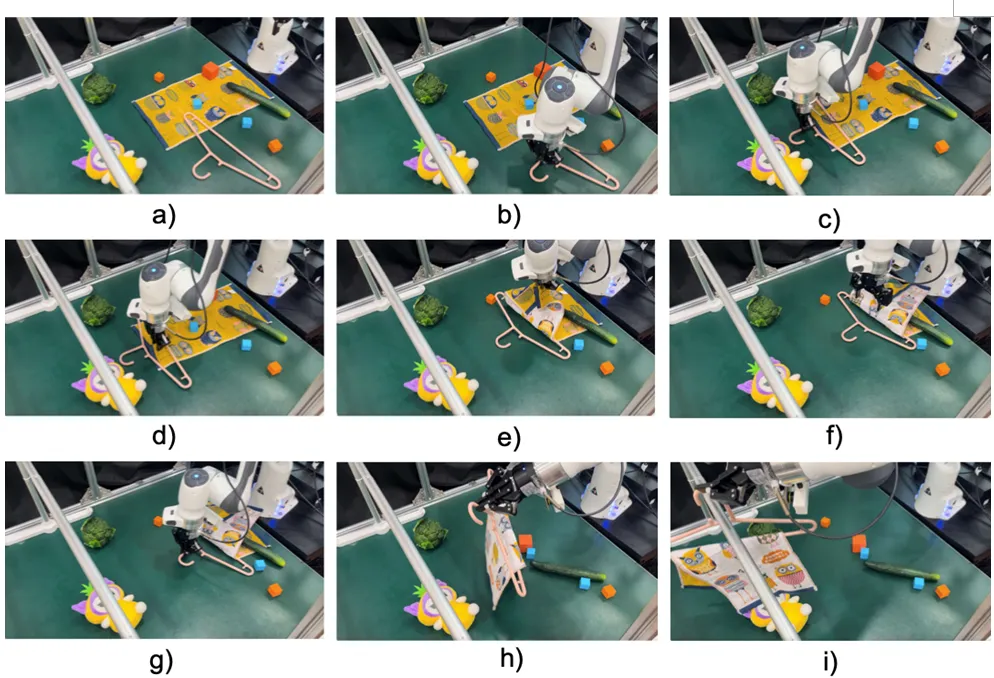

图. SKIL能够在大范围可泛化的长周期操作任务中实现卓越性能

图. SKIL算法挂毛巾任务的泛化实验

SKIL框架为构建数据高效、泛化性强的机器人学习系统提供了全新范式,展现出语义关键点在机器人智能学习中的广阔前景。本论文一作为研究院实习生、清华大学博士生王圣杰,通讯作者为研究院PI、清华大学助理教授高阳。共同作者为研究院实习生、清华大学游嘉诚、胡亦行,清华大学自动化系本科生李炯烨。

论文信息:

SKIL: Semantic Keypoint Imitation Learning for Generalizable Data-efficient Manipulation, Shengjie Wang, Jiacheng You, Yihang Hu, Jiongye Li, Yang Gao†, https://skil-robotics.github.io/SKIL-robotics/, RSS 2025.

分享到