2021-12-06

近日,我院PI冷静文课题组在人工智能顶会AAAI2022及计算机体系结构顶会ASPLOS2022上各发表一篇论文。其中,发表在AAAI的论文“Block-Skim: Efficient Question Answering for Transformer”第一作者为该课题组成员管乐;另一篇发表在ASPLOS上的论文“VELTAIR: Towards High-Performance Multi-Tenant Deep Learning Services via Adaptive Compilation and Scheduling” 第一作者为该课题组成员刘子汉。

冷静文教授及管乐等人在“Block-Skim: Efficient Question Answering for Transformer” 一文中提出了一种根据Transformer模型运算中注意力机制的的运算特征,动态的对问答任务的文本输入序列进行渐进式动态剪枝的模型压缩优化算法。从而使模型在运算的过程中能够动态的选择并减少输入序列的范围和内容,进而减少模型的复杂度以及推理运算量,以达到加速运算的目的。另一方面,借由减少无关输入文本的内容,模型同样可以减少回答问题的上下文范围,聚焦于正确的文本区块和存在逻辑关系的内容上,达到对模型进行正则化的效果,从而提升模型的精确度。

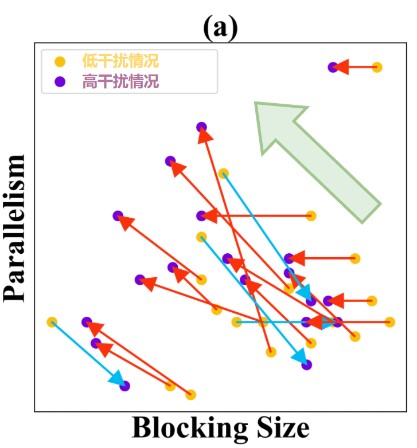

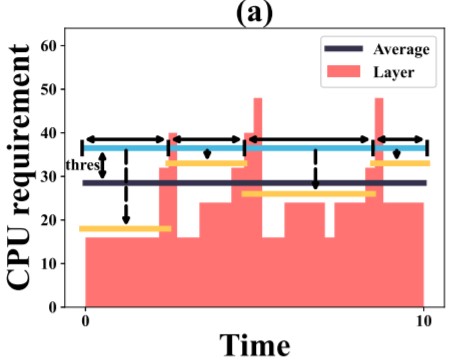

随着硬件算力的快速发展,在单个计算硬件上部署多个深度学习任务场景即多租户深度学习服务中的问题及优化亟待研究。若简单地将编译好的深度学习模型代码部署到单个计算硬件,任由这些任务占用独享、共享资源,则频繁的独享资源冲突、共享资源争用会使得系统整体请求满足率、效率会受到较大的损伤。在“VELTAIR: Towards High-Performance Multi-Tenant Deep Learning Services via Adaptive Compilation and Scheduling”一文中冷静文教授及刘子汉等人提出从一套编译-运行时协同解决方案,在编译时通过静态多版本编译的方式,事先为同一深度学习算子准备若干并行度与局部性不同的代码实现共运行时调度器使用,调度器根据实时共享资源干扰情况选择合适的实现(如图1)。在运行时通过动态调度粒度,与传统基于模型或基于算子的静态粒度调度相比,动态粒度调度能根据运行时负载情况动态调整调度单元大小,在尽可能保证独享资源利用效率的情况下最大程度削减由于某几个算子的独享资源要求极高造成的独享资源冲突的情况(如图2)。最终,VELTAIR在MLPerf上取得了60%的请求满足率提升。

图1 图2

AAAI(the Association for the Advance of Artificial Intelligence)即:美国人工智能协会,是由计算机科学和人工智能领域奠基人Allen Newell、Marvin Minsky、John McCarthy等学者于1979年共同创立,旨在推动智能思维与行为机制的科学理解及机器实现,并促进人工智能的科学研究和规范应用,是国际人工智能领域的重要学术组织之一。该协会主办的年会(AAAI, The National Conference on Artificial Intelligence)是国际人工智能领域的顶级学术会议。AAAI2022将于2022年2月22日到3月1日在加拿大温哥华举办。

ASPLOS(Architectural Support for Programming Languages and Operating Systems)是计算机系统领域顶级会议,是ACM开办的一个以体系结构为核心内容的多学科会议,其研究领域跨越硬件、体系结构、编译器、编程语言、操作系统、网络和应用,尤其关注这些学科间的交叉性研究课题。ASPLOS2022将于2022年2月28日到3月4日在瑞士洛桑举行。